3月17日,NVIDIA GTC 2026大会,理想汽车基座模型负责人詹锟发表演讲,发布了下一代自动驾驶基础模型MindVLA-o1。

18日,理想汽车董事长兼CEO李想在B站发布了其与基座模型负责人詹锟的对话,对MindVLA-o1进行了进一步的解读。

“当视觉、语言和行动统一到一个模型中时,它不再只是自动驾驶模型,而是在逐渐演化为面向物理世界的通用智能体。基于同一套VLA模型,不仅可以控制车辆,也能够扩展到机器人。”詹锟在GTC上总结。

最初,智驾技术的逻辑相当“朴素”。工程师给驾驶系统写清楚规则,遇到不同的路况执行不同规则,再配上一张把每条路都画清楚的高精地图——但规则无穷无尽,永远会有下一个“例外”。

2021年前后,自动驾驶行业第一场技术转型开始:工程师直接把大量人类驾驶数据喂给模型,让模型自己学习。端到端模型输入视觉信号,输出实际操作,直接学习人类驾驶行为。

理想透露,当训练数据积累到1000万条Clips之后,公司研发团队等了5个月,模型平均接管里程只增长了2倍左右,远低于预期。

李想曾对端到端模型打了个不客气的比喻:“猴子开车”——端到端的本质是模仿学习,模型能学会开车的动作,但永远不理解物理世界。

“今天无论是具身的AI在工作,在训练,都是看着2D视频。但这并不是人类在物理世界真正的工作方式。”李想解释,“大部分搞模型的,都想直接做成年以后要做的事,拼命训练。但0-6岁孩子最重要的训练空间、训练能力,根本没解决。”

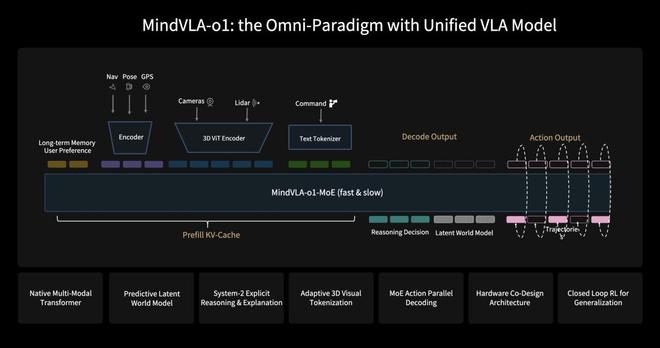

这是VLA出现的背景。感知、思考与行为,从架构设计之初,三种模态就被放入同一表示空间中进行统一训练。

2025年8月,理想随理想i8交付推出全球首个量产上车的VLA司机大模型。而MindVLA-o1是在其基础上的最新成果。

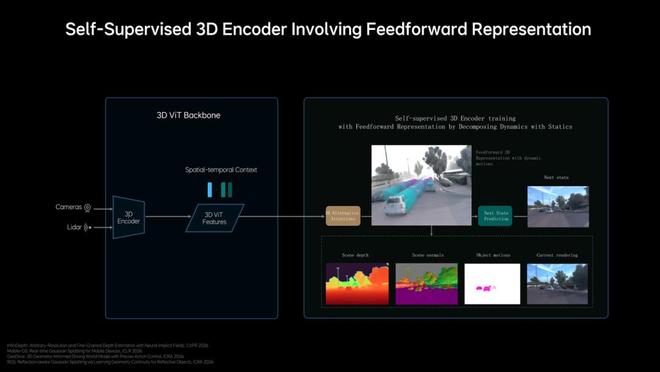

理想设计了自监督的3D ViT(3D Vision Transformer,三维视觉转换器)视觉编码器。训练时同时引入视觉与LiDAR(激光探测与测距)两路数据——前者提供丰富的语义信息,后者提供准确的三维几何结构,让模型在同一表示空间中同时学习几何与语义。

为进一步提升场景理解能力,训练中还引入了前馈式3DGS(3D Gaussian Splatting,三维高斯泼溅)场景表示:系统将场景分解为静态环境与动态物体分别建模,以“下一状态预测”作为自监督信号,驱动模型同时学习深度信息、语义结构与物体运动。

最终得到的3D ViT表示融合了空间结构与时间上下文信息,为后续的思考与行动层提供高质量的三维世界表示。

针对3D感知,训练数据配比也完成重构,大量融入3D数据和自动驾驶图文数据,主动压缩文史类数据比例,并加入未来帧预测生成和稠密深度预测任务,专门激发模型对3D空间的理解与推理能力。

语言模型引入了 System-2式(慢思考系统)的显式推理机制——区别于直觉式的快速反应,模型能在复杂场景中进行更深入的分析与决策。

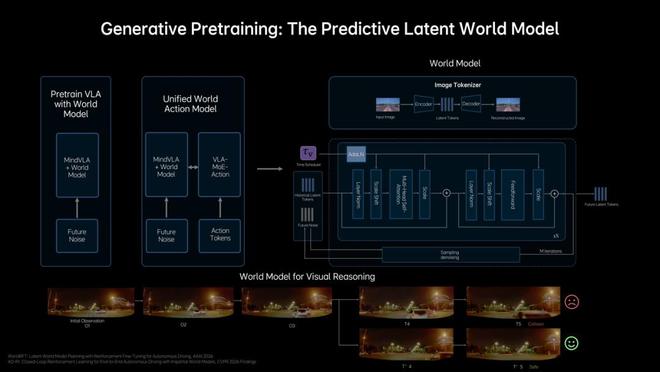

在此基础上,模型还内嵌了Predictive Latent World Model(预测式隐世界模型),让自动驾驶不只理解“当前发生了什么”,还能模拟“接下来会发生什么”。

由于直接生成未来图像的计算成本过高,理想选择在Latent Space(隐空间)中完成预测:系统首先将当前视觉输入编码为一组Latent Tokens(隐变量令牌),作为场景的紧凑表示,再由世界模型基于这些令牌推演未来状态。

这套世界模型经历了三阶段训练:第一阶段用海量视频打底,让模型学会在隐空间里表征未来;第二阶段在MindVLA-o1框架内强化未来推演能力;第三阶段则将世界模型、多模态推理与驾驶行为三者拉到同一目标下联合优化。

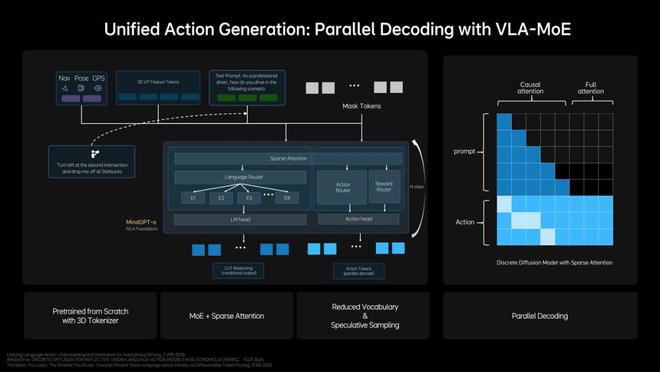

快慢思考机制也被整合进同一模型:简单场景下,模型直接输出Action Token(动作令牌),不走推理链;复杂场景下,先经过一段固定简短的CoT(思维链)模板,再输出动作。

在效率设计上,针对思维链采用小词表加投机推理大幅提速;动作令牌在同一Transformer内以双向注意力机制一次性并行输出,思维链推理则在因果注意力机制下逐字解码,两者并存于同一模型中。

具体来看,Action Expert从3D场景特征、导航目标、驾驶指令中提取关键信息,结合多模态推理生成初始驾驶轨迹。轨迹生成后,Parallel Decoding让所有轨迹点同时输出,而非逐点生成,在长序列轨迹预测场景中,效率优势尤为突出。

Discrete Diffusion Refinement随后对并行生成的轨迹进行多轮迭代优化,类似逐步去噪,最终使轨迹在空间上连续、时间上稳定,并满足车辆动力学约束——整个Diffusion(扩散)过程通过ODE(常微分方程)采样器压缩至2-3步完成。

Diffusion模型还同时预测自车与周围车辆、行人的轨迹,通过联合建模提升复杂交通场景中的博弈能力。对于仍存在偏差的长尾工况,则通过RLHF(基于人类反馈的强化学习)加以修正:筛选大量接管数据建立人类偏好数据集,微调模型的采样过程,使其逐步对齐人类驾驶行为,安全下限随偏好数据的积累持续提升。

模型搭载的3D ViT编码器,复杂度远远超过主流的“2D方案”,对端侧算力提出更高的要求。

它是中国首个采用数据流原生架构的车规级5纳米芯片,天然适配AI推理计算。在标准的大规模矩阵乘计算任务上,马赫100性能较上一代提升约3倍;两颗马赫100实际运行VLA大模型时的有效算力,是英伟达Thor-U的5到6倍。

在马赫100上,理想成功部署参数规模达上一代6倍、计算量提升10倍的VLA模型,实现运行帧率更高,推理速度更快,从传感器输入到车辆执行输出,整体延时仅200到300毫秒。

此外,马赫100还取消了上一代XCU控制器,联合星环OS整合替代,单颗BOM成本大幅低于外购方案。

3D ViT要大规模预训练,强化学习要在仿真环境里反复迭代。传统的逐步优化式重建太慢,无法支撑大规模并行训练。

为此,理想与NVIDIA团队共建了3D Gaussian Splatting渲染引擎及分布式训练框架,渲染速度提升近2倍,整体训练成本降低约75%。

在这个过程中,理想的世界模拟器也升级为前馈式场景重建,可以瞬时生成大规模高保真驾驶场景,模拟环境还能扩展、编辑和生成新场景,不只是复现真实世界。

高精度的模型跑不进车端,能跑进去的精度又不够。为了让模型匹配车端,传统做法是大量实验反复调整模型结构,但这通常需要数月时间。

为了达到更高的效率,理想一方面在模型上通过Sparse Attention(稀疏注意力)机制,进一步提升稀疏化率,保障端侧实时推理效率。

结合Roofline模型刻画硬件计算能力和内存带宽的限制,在模型性能与硬件约束之间建立统一的分析框架,在约2000种架构配置里寻找精度与推理延迟的最优解。

经过实验得出的最终结论相当“反直觉”:算力受限的条件下,“更宽更浅”的模型比“更深”的模型更高效。

例如,今年1月理想更新的OTA 8.2车机系统,在世界模型中加入了毫秒级方向盘和电门动作数据,让VLA进行行为强化学习——横纵向控制不再机械跟随预设参数,基于对当前场景的综合理解动态输出。

在人车混行路段、小路通行、窄路会车等七个典型城区场景里,它的表现格外突出:例如,在人车混行路段,车辆实时预测行人和非机动车的运动意图,横向避让与纵向调速同步规划;在小路通行时,加减速更细腻,动静态障碍物都能合理避让;在窄路会车,车速和横向位置自动调整,纵向减速平稳没Kaiyun官方入口有顿挫。

在一般场景下,VLA能力也有更多变化。例如,语言指令可以直接改变驾驶行为,“开快点,我赶时间”这类说法,模型能够理解并执行了。

据理想透露,截至2025年底,VLA月使用率80%,VLA指令使用次数1225.4万次。用户最常用的三个指令是左右变道、直行、加减速。

在GTC上,MindVLA-o1的一个演示片段,无关自动驾驶,而是驾驭一条机械臂,轻轻拿起一瓶养乐多,倒进桌上的杯子里。

理想的解释是,同一套VLA模型可以驱动不同形态的物理智能体,自动驾驶与机器人控制共用同一套模型与数据体系。不同执行器,本质上对这套模型来说却是同一类问题——理解环境、推理意图、生成动作序列。

2025年,理想研发投入113亿元,AI相关占比50%;2026年1月,理想将研发团队按“造硅基人”的逻辑重构为四大体系——脏器、脑、软件、硬件;2026年Q2,马赫100将完成量产上车。

“人工智能就是在造人。Agent是数字化的人,具身是物理化的人,只是它是硅基的人,不是我们碳基的。”李想称,L4自动驾驶的汽车,会是生活中一个最重要的硅基人。

他表示,未来3到5年中高端汽车的竞争,本质上是具身智能的竞争。过去,从功能机到智能手机的演进,来自芯片和操作系统的改变,而在具身智能时代,改变对应的是芯片和模型的Co-Design。

因此,MindVLA-o1的意义,远不止性能提升。它标志着一种范式的转变:模型开始真正进入三维世界,从对输入的被动响应,转向对环境的主动建模与推演。

自动驾驶的边界正在变得模糊,跨越界线,理想的物理AI之路,或许才刚刚开始。

Copyright © 2024 开云沙盘有限公司 版权所有 备案号:蜀ICP备19012180号 网站地图